文档图形预训练:给大模型”喂“图形

AIGC的技术在不断地演变,要让大模型更好地识别并增强理解,大模型预训练很关键。在传统的NLP预训练中,模型主要依赖于文本信息,来学习文档中的语义和语法规则,而文档图形预训练则引入了图形信息,使得模型能够更好地利用视觉信息来理解文档内容。

文档图形预训练,是一种新型的自然语言处理(NLP)预训练方法,它的基本思想是利用文档中的图形信息,来增强模型对文档内容的理解能力。

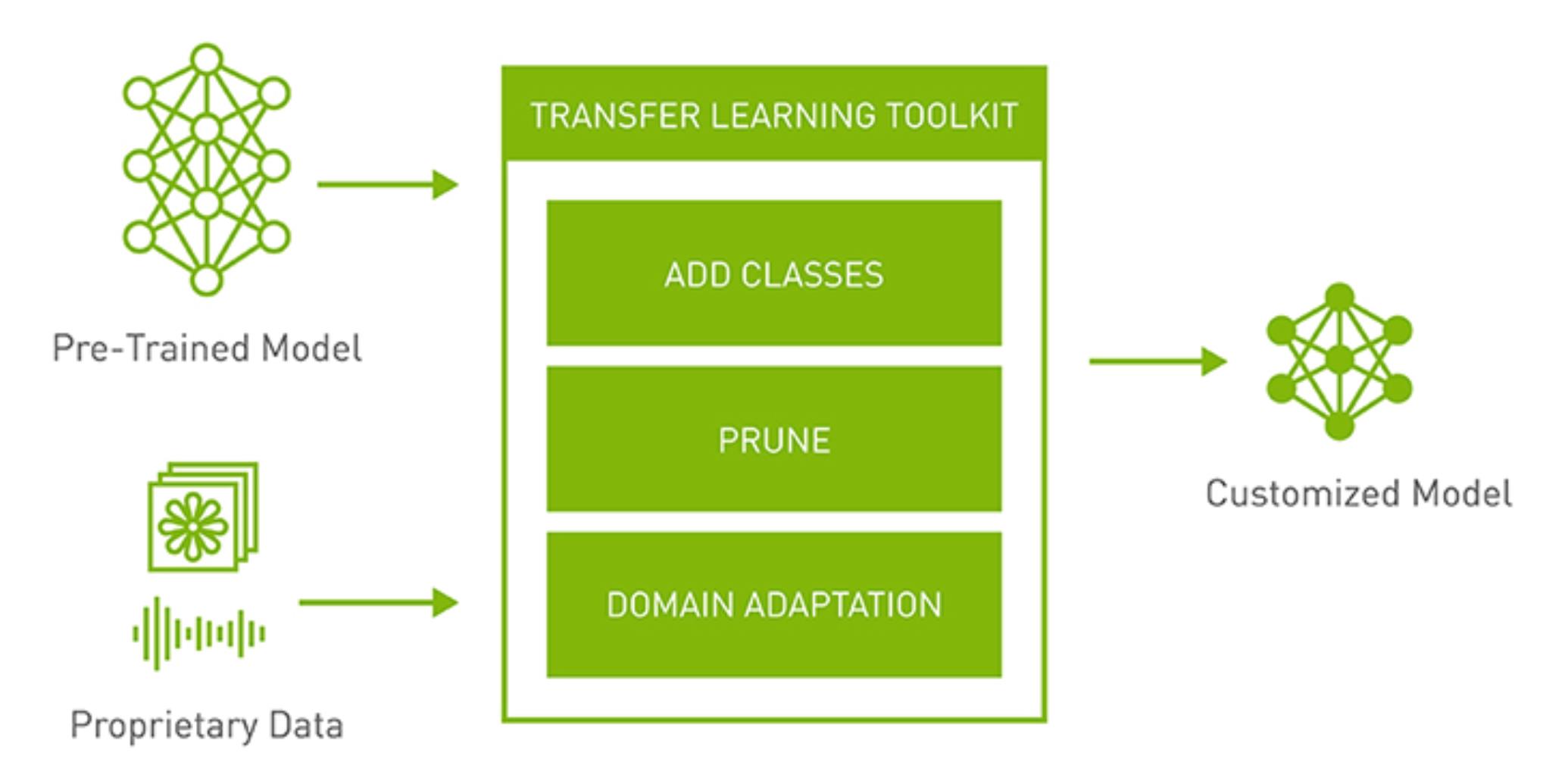

NVIDIA的全新AI预训练模型

通常,文档图形预训练采用以下步骤:

1.数据收集

从大规模的文档数据集中收集各种类型的文档,并将这些文档转化为数字化格式,以便在计算机上进行处理和分析。

2. 文本和图形特征提取

对于每个文档,提取出文本信息和图形信息。文本信息通常包括单词、短语、句子等,而图形信息则包括表格、图表、图像等。这些特征被用作模型输入,以便训练出能够理解和处理这些信息的模型。

3. 模型训练

采用深度学习模型,如Transformer、BERT等,对文本和图形特征进行联合训练。这种训练方法可以使得模型更好地理解文档内容,并将文本和图形信息融合在一起,以便提高模型的性能和准确率。

4. 模型评估和调优

在预训练完成后,采用相关指标对模型进行评估,如准确率、精度、召回率等。根据评估结果,对模型进行调优和改进,以提高其性能和准确率。

文档图形预训练具有哪些优点呢?

首先是提高模型的理解能力。通过引入图形信息,文档图形预训练可以使得模型更好地理解文档内容,并更好地处理和理解文档中的复杂语义和语法结构。

其次,它能增强模型的泛化能力,联合训练文本和图形特征,可以提高模型的泛化能力,使得模型在处理不同类型的数据时具有更好的表现。

另外,文档图形预训练可以 提高模型的可解释性。通过文档图形预训练,可以将模型输出解释为可读的文本或图形表示,从而提高了模型的可解释性和可靠性。

本文由小熊AI网发布,不代表小熊AI网立场,转载联系作者并注明出处:https://www.xiaoxiong360.com/html/software/818.html