过采样和欠采样:处理不平衡数据集常用方法

在机器学习中,过采样和欠采样是处理不平衡数据集的两种常用方法。

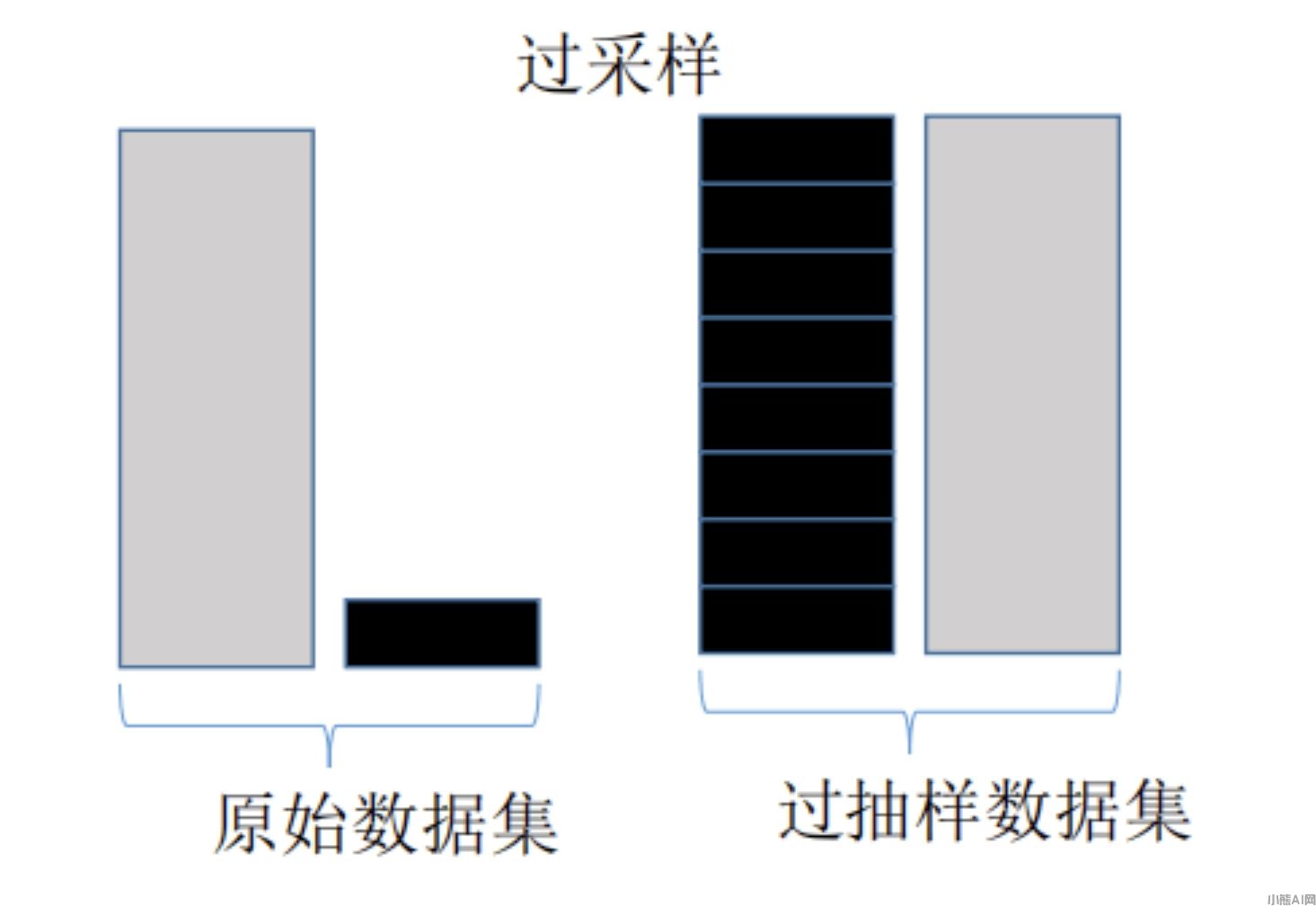

过采样(Oversampling),是指增加少数类的样本数量,使得各类别的样本数量相等或接近。常见的过采样方法有随机过采样、SMOTE(Synthetic Minority Over-sampling Technique)等。过采样的表现是训练集中少数类样本数量增多,可能导致模型对多数类样本的学习不足,从而影响模型的泛化能力。解决方法是在过采样的同时,采用合适的权重分配策略,使模型能够更好地学习到少数类的特征。例如,在SMOTE中,通过计算少数类样本之间的相似度,生成新的少数类样本,并赋予合适的权重。

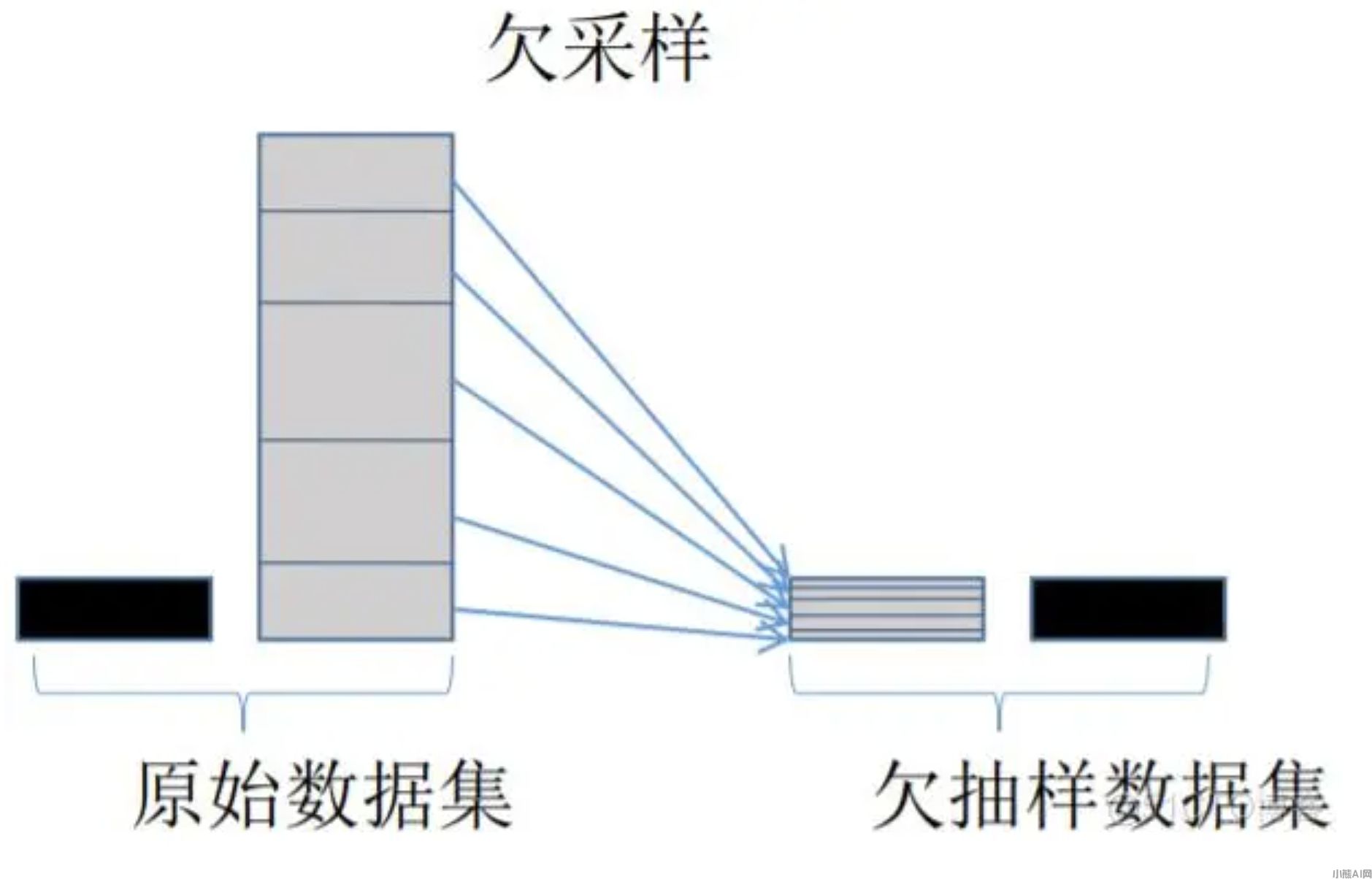

欠采样(Undersampling)是指减少多数类的样本数量,使得各类别的样本数量相等或接近。常见的欠采样方法有随机欠采样、聚类欠采样等。欠采样的表现是训练集中多数类样本数量减少,可能导致模型对多数类样本的学习过度,从而影响模型的泛化能力。解决方法是在欠采样的同时,保留多数类中的代表性样本,使模型能够更好地学习到多数类的特征。例如,在随机欠采样中,从多数类中随机删除一部分样本,同时保证每个类别都有足够的样本进行训练。

举例说明:假设我们有一个二分类问题,正例和负例的数量比例为1:9。为了解决类别不平衡问题,我们可以采用过采样和欠采样的方法进行处理。

1. 过采样:

首先,我们可以使用SMOTE方法对负例进行过采样。具体操作如下:

- 对于每一个负例样本,找到其k个最近邻的正例样本;

- 对于每一个正例样本,根据其与负例样本的距离计算出一个权重;

- 对于每一个负例样本,根据其与正例样本的权重生成一个新的正例样本;

- 重复上述过程,直到负例和正例的数量相等或接近。

2. 欠采样

其次,我们可以使用随机欠采样方法对正例进行欠采样。具体操作如下:

- 从正例中随机选择一部分样本,使其数量与负例相等或接近;

- 保留这些选中的正例样本进行训练。

通过以上方法,我们可以在一定程度上解决类别不平衡问题,提高模型的泛化能力。然而,需要注意的是,过采样和欠采样可能会导致一些信息的丢失,因此在实际应用中需要权衡各种因素,选择合适的处理方法。

本文由小熊AI网发布,不代表小熊AI网立场,转载联系作者并注明出处:https://www.xiaoxiong360.com/html/software/1464.html