神经网络的深度和宽度表示什么意思?

神经网络是一种模拟人脑神经元工作方式的计算模型,通过多个层次的神经元相互连接和传递信息来实现对复杂数据的学习和处理。它广泛应用于机器学习、模式识别、自然语言处理等领域,具有强大的非线性拟合能力和自适应学习能力。

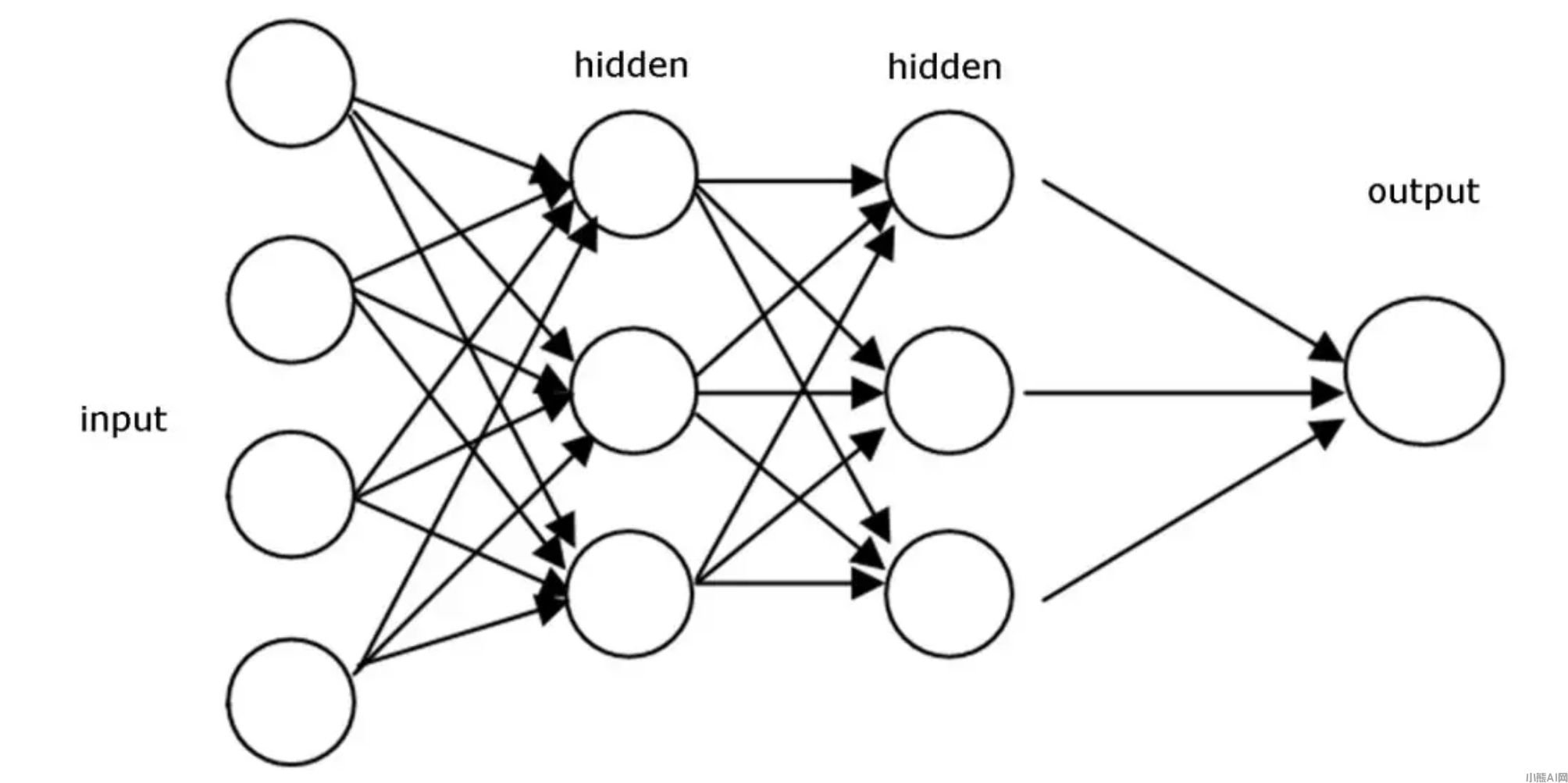

神经网络的深度和宽度是指网络中神经元的数量以及层数。这两个参数对于神经网络的性能和复杂度有着重要的影响。

首先,神经网络的深度指的是网络中包含的层数。一个具有较少层的浅层神经网络,可以看作是一个线性模型,而深层神经网络则可以学习到更复杂的非线性关系。随着层数的增加,神经网络可以逐渐提取出输入数据的不同层次的特征,从而提高对复杂任务的表达能力。然而,增加网络的深度也会带来一些问题,如梯度消失、梯度爆炸等,这些问题可能导致网络难以训练或者收敛速度变慢。因此,在设计深层神经网络时需要考虑如何有效地解决这些问题,例如使用残差连接、批量归一化等技术。

其次,神经网络的宽度指的是每一层中的神经元数量。宽度越大,意味着每一层可以处理更多的特征信息,从而增加了网络的容量和表达能力。然而,增加宽度也会增加网络的参数量和计算复杂度,导致训练时间变长和过拟合的风险增加。为了平衡宽度和复杂度之间的关系,可以使用一些正则化技术,如权重衰减、Dropout等,来减少过拟合的风险。此外,还可以使用卷积神经网络(CNN)或循环神经网络(RNN)等特殊的网络结构来适应不同类型数据的处理需求。

除了深度和宽度之外,还有其他一些参数也会影响神经网络的性能和复杂度,如激活函数的选择、学习率的调整、优化算法的选择等。这些参数的选择需要根据具体的任务和数据集来进行调优,以达到最佳的性能和泛化能力。

通过合理地调整这两个参数以及其他相关参数,可以设计出高效且准确的神经网络模型来解决各种复杂的机器学习问题。

本文由小熊AI网发布,不代表小熊AI网立场,转载联系作者并注明出处:https://www.xiaoxiong360.com/html/software/1379.html