Meta发布全新AI翻译大模型,实现实时语音转换延迟不超过2秒

Meta最近发布了一系列的AI翻译大模型,这些模型被称为Seamless Communication。它们具备实时语音转换的能力,延迟不超过2秒。这一系列模型包括SeamlessExpressive、SeamlessStreaming、SeamlessM4T v2和Seamless,其中前三个已经在GitHub上开源。

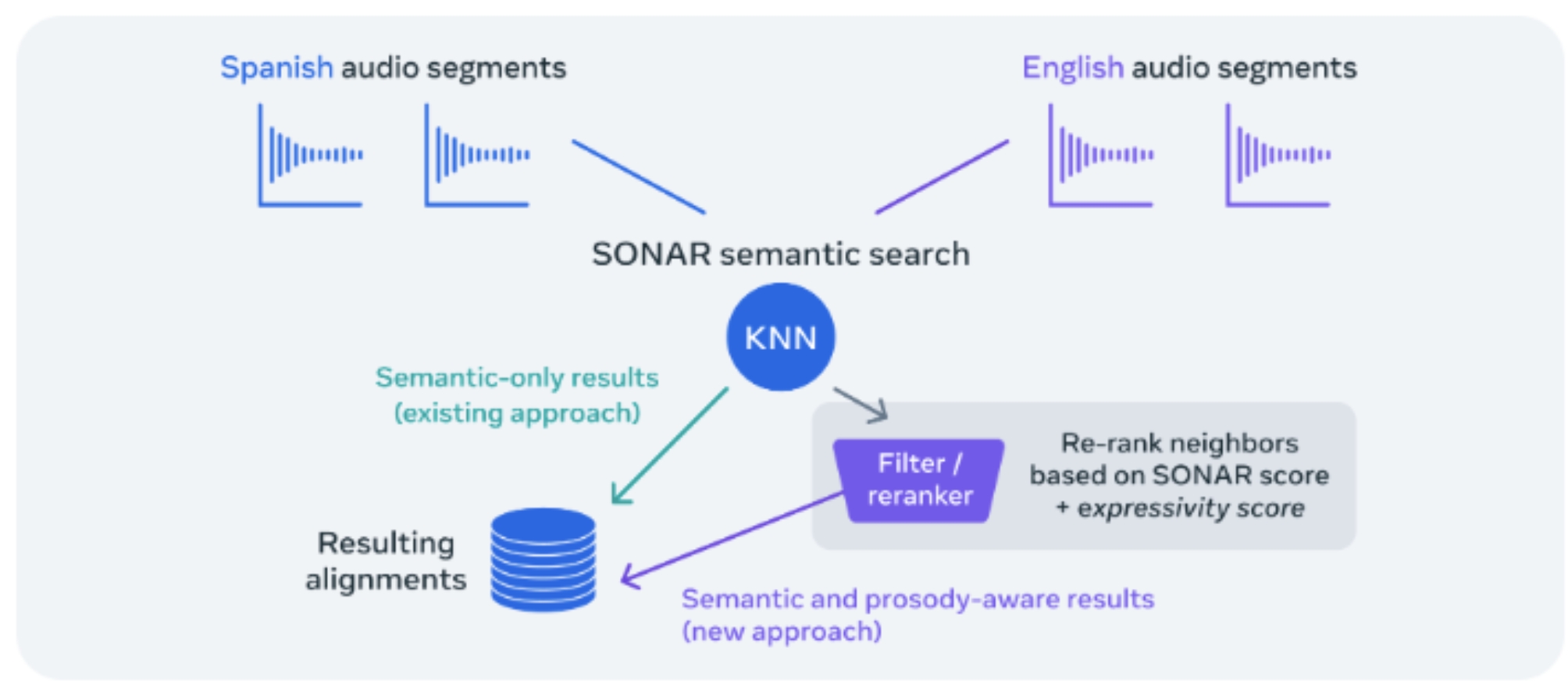

这些模型不仅能够保留跨语言语音的复杂性,还能够模仿语气、语速、情感等细致特征,使得AI翻译更加生动有趣。在技术架构方面,Meta采用了非自回归架构,提高了模型的扩展性和鲁棒性,特别适用于流媒体场景。核心算法EMMA能够智能地决定何时已经拥有足够的信息来生成下一个语音片段或目标文本,同时采用了UnitY2等新架构来增强语音生成能力。

为了解决翻译准确性的问题,Meta引入了“毒性缓解”技术,在翻译生成过程中自动检测和调整生成的有毒单词,显著减少了翻译的“毒性”。为了防止滥用风险,Meta还为音频添加了水印,通过在音频中嵌入不可察觉的信号,可以准确追踪音频的来源,并对抗各种攻击手段。

这一系列模型的开源不仅包括模型本身,还涵盖了元数据、数据和数据对齐工具。其中元数据包括58.5万小时的语音文本对,是目前容量最大、语言覆盖最广的语音语料库之一。

Meta的这一系列技术突破。它们不仅提升了翻译速度,还注重模仿语音的表现力和保护用户隐私的技术手段。这一技术创新为未来语音翻译和交流领域带来了更加广阔的可能性。

本文由小熊AI网发布,不代表小熊AI网立场,转载联系作者并注明出处:https://www.xiaoxiong360.com/html/info/2411.html