名词解释:长短期记忆循环神经网络(LLM)

LLM是指“长短期记忆循环神经网络”(Long Short-Term Memory),它是一种递归神经网络(RNN)的特殊类型,特别适合处理序列数据。

LLM技术具有捕捉序列数据长期依赖性的能力,在自然语言处理(NLP)、语音识别、推荐系统等领域有着广泛的应用。

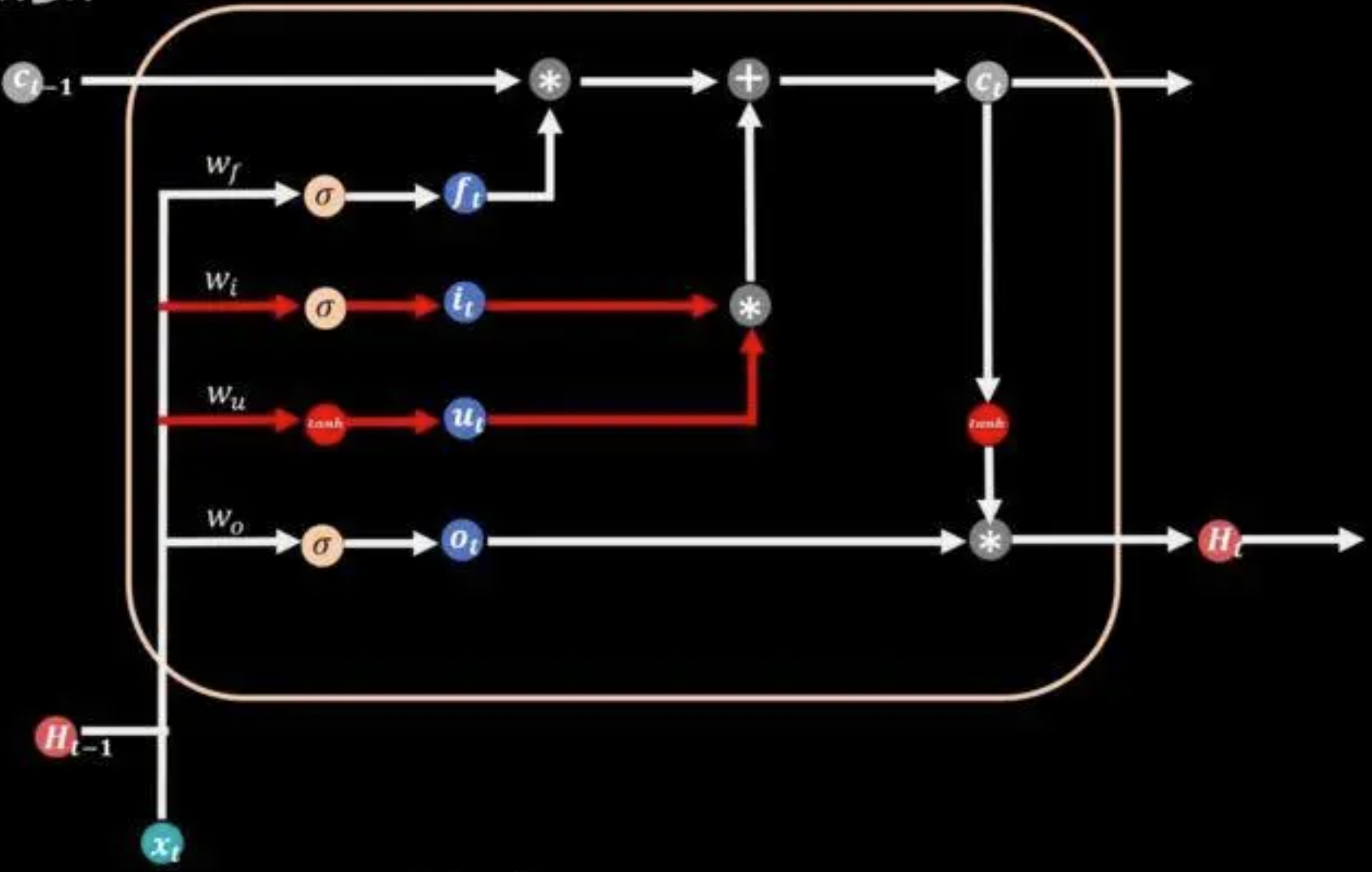

LLM模型的核心思想结合了长短时记忆网络(LSTM)、门控循环单元(GRU)的优点。它继承了LSTM中记忆单元的设计,能够有效地捕获序列中的长期依赖关系。同时,它又借鉴了GRU中门控机制的思路,通过控制当前时刻信息的更新,来减轻梯度消失/爆炸问题。

具体来说,LLM模型在每个时刻t的更新中,引入了两个门控机制:更新门(update gate)和遗忘门(forget gate)。更新门控制了新信息的流入程度,遗忘门则决定了哪些信息需要被遗忘。这两个门控机制的设计,使得LLM能够更好地适应序列数据的变化,提高了模型的性能。

此外,LLM模型在处理序列数据时,还引入了"分段"概念。它将序列划分成多个子序列,对每个子序列进行独立的处理。这种"分段"处理方式能够有效降低计算复杂度,提高模型的训练和推理速度。

LLM技术是一种非常优秀的序列数据处理方法,具有强大的长期依赖性捕捉能力和高效的计算性能。它在各种自然语言处理任务中表现优异,如文本分类、情感分析、机器翻译等。同时,LLM技术也适用于其他序列数据处理领域,如语音识别、推荐系统等。

本文由小熊AI网发布,不代表小熊AI网立场,转载联系作者并注明出处:https://www.xiaoxiong360.com/html/aibaike/1029.html