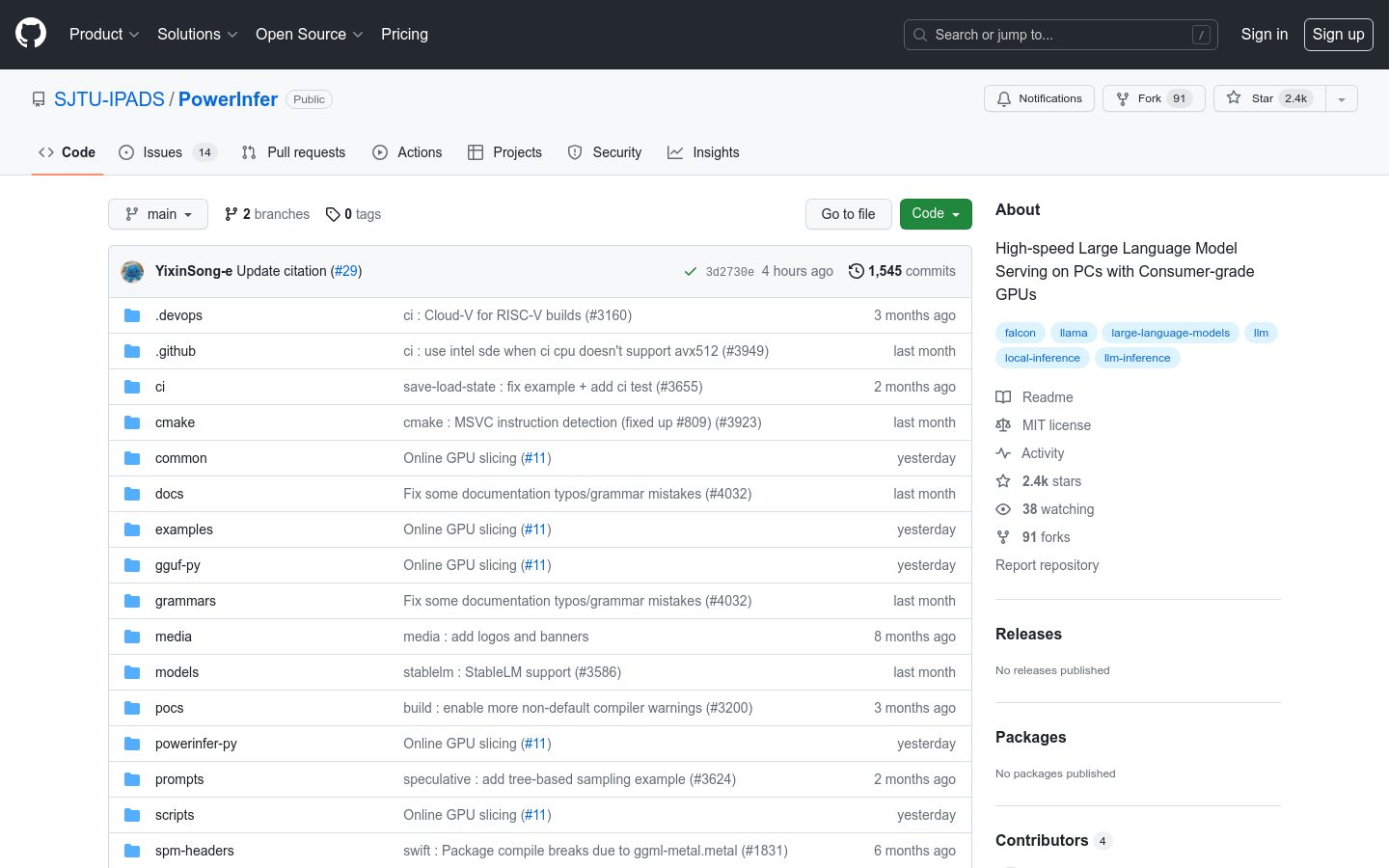

PowerInfer: 在个人PC布署高速大型语言模型推理的引擎

属于AI的时代正在来临,在工作和生活中,AI工具需要经常被使用,以便轻松完成完成各类任务,在这里,小熊AI网向你推荐“PowerInfer”,希望能帮助到你。

PowerInfer 是一个在个人电脑上利用消费级 GPU 进行高速大型语言模型推理的引擎。它利用 LLM 推理中的高局部性特点,通过预加载热激活的神经元到 GPU 上,从而显著降低了 GPU 内存需求和 CPU-GPU 数据传输。PowerInfer 还集成了自适应预测器和神经元感知的稀疏运算符,优化神经元激活和计算稀疏性的效率。它可以在单个 NVIDIA RTX 4090 GPU 上以平均每秒 13.20 个标记的生成速率进行推理,比顶级服务器级 A100 GPU 仅低 18%。同时保持模型准确性。

PowerInfer需求人群

PowerInfer 适用于在本地部署大型语言模型的高速推理。

PowerInfer产品特色

利用稀疏激活和 “热”/“冷” 神经元概念进行高效的 LLM 推理

无缝集成 CPU 和 GPU 的内存 / 计算能力,实现负载均衡和更快的处理速度

与常见的 ReLU 稀疏模型兼容

设计和深度优化用于本地部署在消费级硬件上,实现低延迟的 LLM 推理和服务

向后兼容性,支持与 llama.cpp 相同的模型权重进行推理,但不会有性能提升

本文由小熊AI网发布,不代表小熊AI网立场,转载联系作者并注明出处:https://www.xiaoxiong360.com/html/product/2717.html