数据投毒,你知道是什么意思吗?

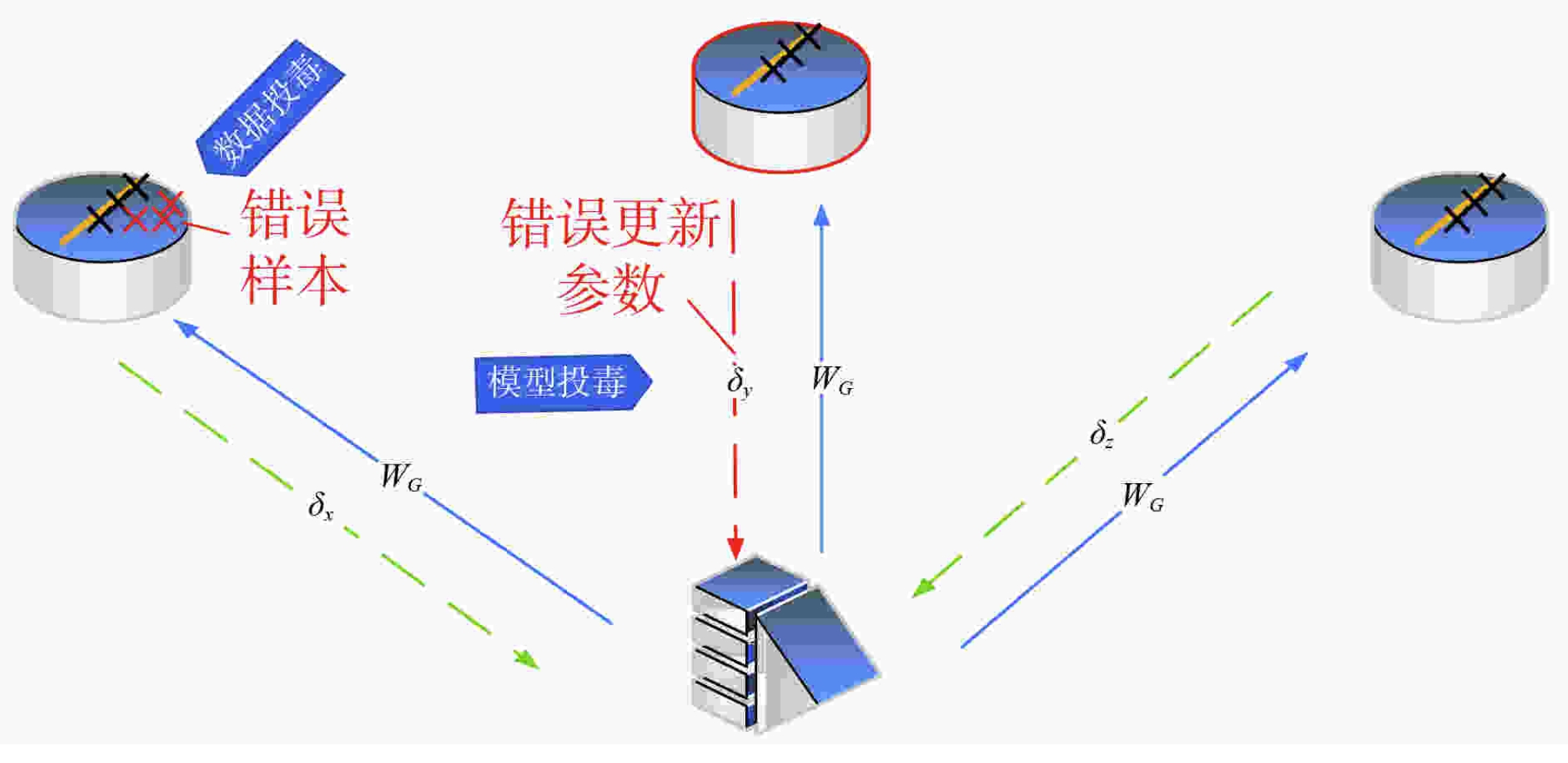

数据投毒(Data Poisoning)是一种攻击方法,攻击者通过向训练数据中添加恶意样本或修改已有样本,以影响机器学习模型的训练过程和预测结果。这种攻击方法的目的是破坏模型的性能,使其在实际应用中产生错误或不准确的预测。

我们来举例说明一下。

假设我们有一个用于识别猫和狗的图片分类模型。攻击者想要破坏这个模型,使其在识别狗的图片时总是误判为猫。为了实现这个目标,攻击者可以采取以下步骤:

1. 收集一些真实的猫和狗的图片,以及一些经过篡改的猫和狗的图片。篡改的方法可以是添加噪声、裁剪图片、旋转图片等,使图片的特征发生变化。

2. 将篡改后的图片与原始图片混合在一起,形成一个包含恶意样本的新数据集。例如,攻击者可以将篡改后的狗图片与原始狗图片按照一定比例混合,使得新数据集中的狗图片既包含真实的狗图片,也包含被篡改的狗图片。

3. 使用这个新的数据集来训练模型。由于恶意样本的存在,模型在训练过程中会学习到错误的信息,导致在识别狗的图片时产生误判。

4. 在模型训练完成后,攻击者可以使用篡改后的图片来测试模型的性能。如果模型仍然能够正确地识别出这些图片是狗,那么攻击者可以尝试使用更复杂的篡改方法,或者增加恶意样本的比例,以提高攻击的成功率。

需要注意的是,数据投毒攻击通常需要攻击者具备一定的专业知识和技能,以便对数据进行有效的篡改。此外,随着对抗性机器学习(Adversarial Machine Learning)领域的发展,越来越多的研究关注如何防御数据投毒攻击和其他类型的对抗性攻击。因此,保护机器学习模型免受数据投毒攻击的影响是一个持续的挑战。

本文由小熊AI网发布,不代表小熊AI网立场,转载联系作者并注明出处:https://www.xiaoxiong360.com/html/QA/2311.html